تتبلور طموحات دولة الإمارات العربية المتحدة في أن تصبح رائدة عالميًا في مجال الذكاء الاصطناعي من خلال استراتيجية الإمارات للذكاء الاصطناعي 2031. فمدن مثل دبي وأبوظبي لا تكتفي بتبني الذكاء الاصطناعي فحسب، بل تدمجه في صميم خدماتها العامة – بدءًا من الأمن والصحة، مروراً بالعدالة والخدمات البلدية. ومع ذلك، يثير هذا التحول الرقمي الجذري تساؤلات جوهرية حول الأخلاقيات، والشفافية، والحوكمة.

بالنسبة لشركات التكنولوجيا، والمكاتب الاستشارية، ولا سيما وكالات الويب في دبي والإمارات، لم تعد المعرفة التقنية البسيطة بنماذج الذكاء الاصطناعي كافية. بل أصبح من الضروري فهم وإدماج الأطر التنظيمية الإماراتية (مثل قانون حماية البيانات الشخصية PDPL) لضمان الامتثال، والإنصاف الخوارزمي، وثقة المواطنين. ويجب أن تتوافق عروض الخدمات، بما في ذلك تصميم المواقع في دبي وتطوير تطبيقات الهاتف المحمول، الآن مع مبادئ "الثقة بالتصميم" (Trust by Design).

يحلل هذا الدليل الشامل المشهد التنظيمي، والتحديات الأخلاقية الخاصة بدولة الإمارات، وخارطة الطريق الاستراتيجية للجهات الفاعلة التي تسعى لتصبح شريكًا موثوقًا به في تطوير الذكاء الاصطناعي الأخلاقي في الإمارات.

رؤية الإمارات ومبادئ الذكاء الاصطناعي الأخلاقية

تعتمد حوكمة الذكاء الاصطناعي في دولة الإمارات على نهج استباقي يسعى إلى تحقيق أقصى قدر من فوائد الذكاء الاصطناعي مع التخفيف من المخاطر الاجتماعية والأخلاقية.

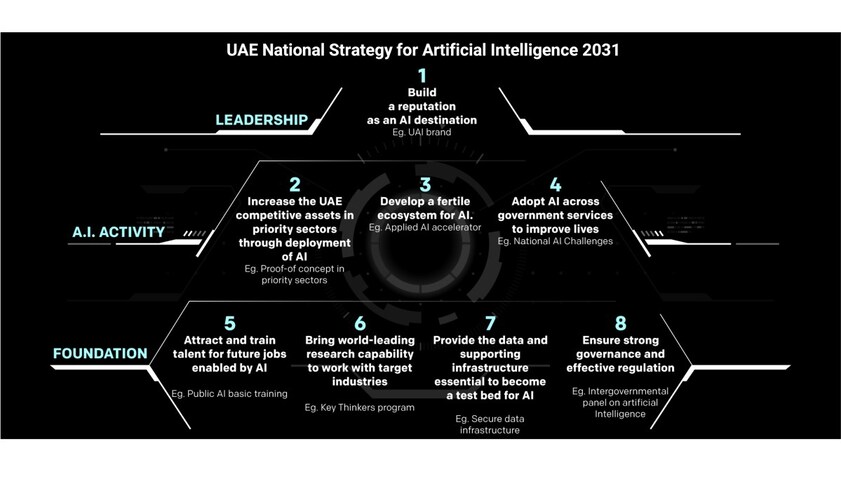

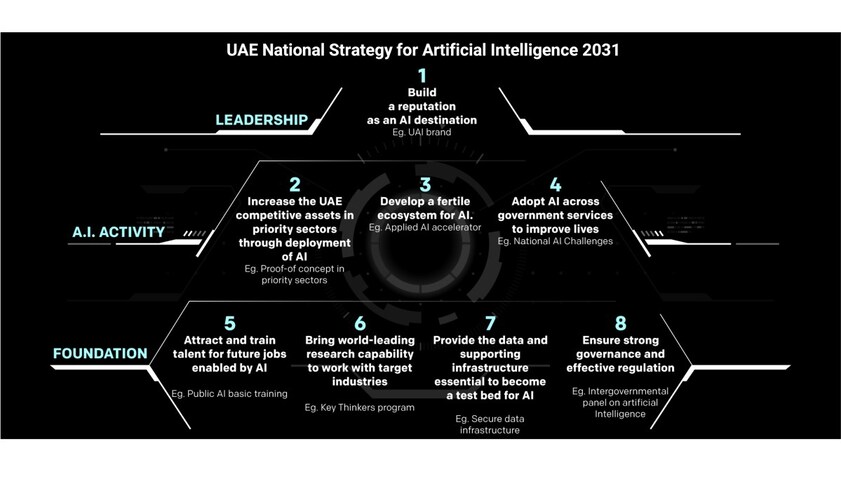

استراتيجية الذكاء الاصطناعي 2031 وإطار الحوكمة

تهدف استراتيجية الذكاء الاصطناعي 2031 إلى وضع دولة الإمارات في المرتبة الأولى عالميًا من حيث الاستثمار وتطبيق الذكاء الاصطناعي. ولتحقيق هذا الهدف، وضعت السلطات إطار حوكمة للذكاء الاصطناعي بهدف تنظيم استخدامه في القطاعات الرئيسية.

يتم تنظيم هذا الإطار بشكل عام حول:

- المبادئ التوجيهية الأخلاقية (المستوى العالي): تحددها الكيانات الفيدرالية والمحلية (على سبيل المثال، مؤسسة دبي للمستقبل، دبي الذكية/دبي الرقمية).

- اللوائح القطاعية: قواعد خاصة بالصحة (معالجة البيانات الطبية)، والتمويل، أو الأمن.

- تشريعات البيانات: قانون حماية البيانات الشخصية (PDPL) هو حجر الزاوية الذي يحكم جمع واستخدام البيانات الشخصية، وهي ضرورية لتدريب نماذج الذكاء الاصطناعي.

بالنسبة لوكالة تطوير ويب في دبي، هذا يعني أن كل مشروع للذكاء الاصطناعي للقطاع العام يجب أن يبدأ بتحليل الامتثال وليس بالبرمجة.

الأركان الثلاثة للذكاء الاصطناعي الأخلاقي

تعتمد أخلاقيات الذكاء الاصطناعي، لا سيما في سياق الخدمات العامة، على ثلاثة أركان أساسية. وهذا هو الأساس الذي تقوم عليه الثقة العامة وشرعية القرارات التي تتخذها الأنظمة الآلية.

| الركن الأخلاقي |

التعريف والتأثير على الإمارات |

دور الشركاء الرقميين |

| الإنصاف (Fairness) |

تجنب التمييز والتحيز الخوارزمي على أساس الأصل، أو الجنس، أو الوضع الاجتماعي. وهو أمر بالغ الأهمية في أنظمة العدالة أو توزيع الخدمات الاجتماعية. |

تدقيق مجموعات بيانات التدريب بحثًا عن التحيز. استخدام تقنيات التعلم العادل (Fair Learning). |

| الشفافية (Transparency) |

جعل أنظمة الذكاء الاصطناعي مفهومة. يجب على المواطنين فهم كيف تم اتخاذ القرار، خاصة إذا كان له تأثير كبير على حياتهم. |

تطوير واجهات المستخدم (UI) التي توضّح بوضوح الأساس المنطقي لتوصيات الذكاء الاصطناعي، مثل واجهات قابلية التفسير XAI. |

| المساءلة (Accountability) |

تحديد الجهة المسؤولة بوضوح في حالة حدوث خلل، أو خطأ خوارزمي، أو ضرر. تقع المسؤولية النهائية غالبًا على الكيان العام أو المشغّل. |

دمج سجلات تدقيق غير قابلة للتغيير — قد تكون عبر شفافية البلوك تشين — لتتبع كل قرار ومصدره. |

المشهد التنظيمي الإماراتي: PDPL والسلطات الرئيسية

تتميز البيئة التنظيمية في دولة الإمارات بأنها ديناميكية وتفرض متطلبات صارمة تتجاوز في كثير من الأحيان الأطر الدولية.

قانون حماية البيانات الشخصية (PDPL)

يعد قانون حماية البيانات الشخصية (المرسوم بقانون اتحادي رقم 45 لسنة 2021) هو الإطار الرئيسي الذي يحكم حماية البيانات في الإمارات. وتأثيره على الذكاء الاصطناعي كبير.

- الموافقة والغرض: يتطلب القانون موافقة واضحة ومحددة ومستنيرة لجمع ومعالجة البيانات. يجب تدريب نماذج الذكاء الاصطناعي ببيانات يتوافق غرض استخدامها مع الموافقة الأولية.

- الحق في السحب: يحق للأفراد سحب موافقتهم وطلب حذف بياناتهم. يجب تصميم أنظمة الذكاء الاصطناعي للسماح بـ "النسيان" الخوارزمي.

- القرارات الآلية: ينظم القانون بشدة القرارات المتخذة بالكامل بناءً على المعالجة الآلية، مما يضمن حق المواطنين في التدخل البشري والاعتراض.

بالنسبة لوكالة تطوير ويب في دبي تعمل على تطوير منصة حكومية، يجب أن يكون الامتثال للقانون هو أساس البنية الخلفية، وليس ميزة مضافة.

اللوائح المحلية والقطاعية

لدى دبي وأبوظبي، كسلطتين رائدتين، أطر عمل محددة:

| السلطة / الإطار |

الهدف الرئيسي في سياق الذكاء الاصطناعي |

التأثير على التطوير |

| دبي الرقمية (أو كياناتها) |

تحديد سياسات الذكاء الاصطناعي على مستوى المدينة؛ تعزيز الشفافية والبيانات المفتوحة. |

اعتماد معايير التشغيل البيني (API) ومعايير الأمن السيبراني لجميع الحلول الحكومية. |

| سوق أبوظبي العالمي (ADGM) |

تنظيم الذكاء الاصطناعي في قطاع التكنولوجيا المالية (الخدمات المالية المعتمدة على الذكاء الاصطناعي). |

اتباع التوجيهات المتعلقة بإدارة المخاطر الخوارزمية في الأنظمة المالية العامة. |

| وزارة الصحة ووقاية المجتمع (MOHAP) |

وضع معايير صارمة للذكاء الاصطناعي في الصحة، بما يشمل التشخيص والعلاج. |

اشتراط التحقق السريري من نماذج الذكاء الاصطناعي قبل نشرها وتعزيز حماية خصوصية البيانات الطبية. |

التحدي التقني: التحيز، وقابلية التفسير (XAI)، والمتانة

إن تطبيق المبادئ الأخلاقية والتنظيمية يمر بالضرورة عبر حلول تقنية متقدمة. وهنا يصبح دور وكالة تطوير ويب متخصصة حاسماً.

تخفيف التحيز الخوارزمي

يعد التحيز هو الخطر الأكثر شيوعًا في الذكاء الاصطناعي. ويمكن أن يكون غير مقصود (تحيز البيانات التاريخية) أو خبيثًا.

- تحيز التمثيل: إذا كانت مجموعة بيانات التعرف على الوجه لأجهزة شرطة دبي تحتوي على أقلية صغيرة فقط من مجموعات معينة، فسيكون الذكاء الاصطناعي أقل دقة لتلك المجموعات، مما يؤدي إلى عدم الإنصاف.

- مقاييس الإنصاف: يجب على المطورين استخدام مقاييس الإنصاف (على سبيل المثال، Equal Opportunity Difference أو Demographic Parity) لاختبار النماذج وتعديلها قبل البدء بالإنتاج.

- التدقيق المستمر: يجب أن تتضمن المنصات المنشورة أدوات تدقيق مستمر (مراقبة الأداء) للكشف عن انحراف النموذج (model drift) وأي تحيزات جديدة قد تظهر بمرور الوقت.

قابلية تفسير الذكاء الاصطناعي (XAI)

في الخدمات العامة لدولة الإمارات، يُعتبر غموض "الصناديق السوداء" أمرًا غير مقبول. لذا فإن قابلية تفسير الذكاء الاصطناعي (XAI) هي ضرورة تنظيمية وأخلاقية.

الهدف من قابلية التفسير هو تمكين المستخدم (الموظف، أو المواطن، أو المدقق) من فهم سبب اتخاذ الذكاء الاصطناعي قرارًا معينًا.

| تقنية XAI |

الوصف |

التطبيق في الخدمة العامة الإماراتية |

| LIME |

تفسيرات محلية لنموذج مستقل وقابل للتفسير، حيث يقوم بشرح قرار النموذج من خلال تحليل سلوكه بشكل محلي. |

شرح سبب رفض قرض بنكي بلدي لشخص محدد بطريقة مفهومة وقابلة للتبرير. |

| SHAP |

تفسيرات مضافة (SHAP) تعتمد على قيمة Shapley، وتحدد مدى تأثير كل خاصية إدخال على النتيجة النهائية للنموذج. |

توضيح العوامل (مثل العمر، السجل، الموقع) التي دفعت نظام دعم قرار الشرطة لتصنيف منطقة على أنها "مرتفعة المخاطر". |

| واجهات المستخدم (UI) لـ XAI |

تصميم واجهات رسومية تعرض مخرجات LIME/SHAP بطريقة مبسّطة وواضحة للمستخدمين غير التقنيين. |

على وكالات الويب في دبي تقديم شروحات بصرية مفهومة تساعد المواطنين على فهم مبررات القرارات الحكومية المعتمدة على الذكاء الاصطناعي. |

الشفافية والثبات عبر تقنية البلوك تشين (Blockchain)

لضمان سلامة بيانات التدريب وإمكانية تتبع القرارات، تعد تقنية البلوك تشين أداة حوكمة أساسية في دولة الإمارات.

- شفافية البلوك تشين: استخدام البلوك تشين لتسجيل التجزئة (hash - البصمة الرقمية) لمجموعات بيانات التدريب. ويثبت هذا أن النموذج قد تم تدريبه بمجموعة بيانات محددة ولم يتم تغييرها لاحقًا.

- سجلات التدقيق غير القابلة للتغيير: يتم تسجيل كل قرار حاسم يتخذه الذكاء الاصطناعي (مثل التوصية بالعقوبة، وتقييم ملف الجنسية) كمعاملة على بلوك تشين خاصة، مما يضمن عدم إمكانية تعديلها بأثر رجعي.

الاستراتيجية الرقمية: دور وكالات الويب والهاتف المحمول في الامتثال

بالنسبة لوكالات تطوير الويب والهاتف المحمول في الإمارات، فإن مشاريع الذكاء الاصطناعي في القطاع العام ليست مشاريع تطوير عادية؛ بل هي مشاريع حوكمة وأمن.

نهج "الثقة بالتصميم" (Trust by Design)

تستمد هذه المنهجية إلهامها من الخصوصية بالتصميم وتوسعها لتشمل المبادئ الأخلاقية للذكاء الاصطناعي.

- مرحلة التصميم (Wireframing/UX): دمج ميزات XAI في تصميم المواقع في دبي وتطبيقات الهاتف المحمول، مما يجعل تفسيرات الذكاء الاصطناعي سهلة الوصول وغير مخفية في قائمة فرعية.

- مرحلة البنية (الخلفية - Backend): الفصل الواضح بين البيانات الخام، وبيانات التدريب، والبيانات التشغيلية. استخدام خدمات الحوسبة السحابية الإماراتية من أجل توطين البيانات (وهو متطلب رئيسي في قانون حماية البيانات الشخصية).

- مرحلة الاختبار (QA): إضافة خطوة إلزامية للاختبار الأخلاقي (Ethical Testing & Bias Testing) قبل النشر.

تطوير تطبيقات الهاتف المحمول في دبي للمساءلة المواطنة

تُعد تطبيقات الهاتف المحمول الحكومية نقطة التفاعل الأكثر شيوعًا مع المواطنين. ويجب أن تكون المكان الذي تتحقق فيه الأخلاق فعليًا.

- لوحة تحكم للموافقة: يجب أن يسمح تطبيق الهاتف المحمول للمواطنين بإدارة موافقتهم بشكل دقيق على استخدام بياناتهم من قبل أنظمة الذكاء الاصطناعي المختلفة.

- قناة الاعتراض: دمج زر أو روبوت محادثة (مثل، روبوت محادثة يعتمد على الذكاء الاصطناعي الأخلاقي) يسمح بالاعتراض السريع على قرار آلي وطلب مراجعة بشرية.

- شفافية المصادر: الإشارة بوضوح في التطبيق إلى مصدر البيانات المستخدمة للقرار (على سبيل المثال، "القرار يستند إلى بيانات التسجيل من هيئة الطرق والمواصلات ودائرة الأراضي والأملاك").

عرض القيمة للمستشارين في التسويق في دبي

في هذا السوق شديد التنظيم، يجب على المستشارين في التسويق في دبي أن يبيعوا الأمن والامتثال قبل مجرد السرعة أو الحداثة في الذكاء الاصطناعي.

- الاعتماد والتدقيق: وضع الوكالة كمطور معتمد أو مدقق للامتثال لقانون حماية البيانات الشخصية/حوكمة الذكاء الاصطناعي في الإمارات.

- محتوى موثوق: يجب أن ينشر الموقع الإلكتروني الخاص بالوكالة (عبر استراتيجية E-E-A-T قوية) دراسات حالة مفصلة حول تخفيف التحيز ونشر XAI، لإثبات خبرتها الأخلاقية.

التطبيقات القطاعية: الذكاء الاصطناعي الأخلاقي قيد التنفيذ

يختلف تأثير الذكاء الاصطناعي الأخلاقي باختلاف القطاع العام. فالتحديات في العدالة تختلف اختلافًا كبيرًا عن تلك الموجودة في إدارة البنية التحتية.

العدالة والشرطة: الخطر العالي للتحيز

يُعتبر الذكاء الاصطناعي المستخدم في العدالة أو الشرطة (مثل التنبؤ بالجريمة، وتحليل مخاطر العودة إلى الإجرام، وتصنيف الأدلة) ذا مخاطر أخلاقية عالية.

- الإطار الأخلاقي: اشتراط التدخل البشري المنهجي (Human in the Loop) قبل تطبيق أي قرار حاسم قائم على الذكاء الاصطناعي.

- قابلية التفسير: يجب أن يكون النظام قادرًا على أن يشرح لقاضٍ أو محامٍ سبب توصية الذكاء الاصطناعي بعقوبة معينة أو مستوى معين من المراقبة. فالغموض غير مقبول في هذا المجال.

- أمن البيانات: استخدام تقنيات التعلم الموحد (Federated Learning) لتدريب النماذج على البيانات الحساسة دون نقلها مطلقًا خارج صوامعها الآمنة (على سبيل المثال، عدم دمج سجلات الشرطة والسجلات الطبية).

الصحة والخدمات الاجتماعية

يحقق الذكاء الاصطناعي في الرعاية الصحية (التشخيص، تخصيص الموارد) فوائد عالية، ولكن معالجة البيانات الطبية تعتبر شديدة الحساسية.

- إخفاء الهوية مقابل الاسم المستعار: يفضل تدريب نماذج الذكاء الاصطناعي على بيانات مستعارة (استبدال المعرفات برموز) بدلاً من بيانات مجهولة الهوية، للحفاظ على إمكانية التتبع اللازمة في حالة الحاجة السريرية أو التدقيق.

- الحق في الاعتراض على التشخيص: يجب أن يكون للمواطن حق صريح في طلب رأي بشري ثانٍ إذا تم إنشاء تشخيص أو توصية علاج بواسطة الذكاء الاصطناعي.

الخدمات البلدية والبنية التحتية (مخاطر معتدلة)

في إدارة المرور (RTA)، أو الطاقة (DEWA)، أو التخطيط الحضري (DLD)، تكون المخاطر الأخلاقية أقل، لكن الشفافية تظل ضرورية.

- شفافية الخدمة: يجب ألا تفضل أنظمة الذكاء الاصطناعي التي تعمل على تحسين إشارات المرور بشكل منهجي أحياء معينة على حساب أخرى. يجب تطبيق مقاييس الإنصاف حتى على الأنظمة غير الحاسمة.

- بساطة التفسير: يمكن تبسيط التفسير: "لقد زاد وقت انتظارك بنسبة 10% بسبب ارتفاع غير متوقع في حركة المرور في قطاع مطار دبي، تم اكتشافه بواسطة الذكاء الاصطناعي الخاص بهيئة الطرق والمواصلات."

الخطوات التالية: الذكاء الاصطناعي في الإمارات ما بعد 2025

إن تطور الإطار الأخلاقي في دولة الإمارات مستمر ويتجه نحو تقنيات المستقبل والتحديات العالمية.

التقارب مع الميتافيرس والهوية الرقمية

تستثمر دبي بكثافة في الميتافيرس. وسيكون الذكاء الاصطناعي ضروريًا لملء هذه العوالم الافتراضية وتقديم الخدمات الحكومية في الفضاء ثلاثي الأبعاد.

-

أخلاقيات الأفاتار (Avatars): يجب أن يكون الذكاء الاصطناعي الذي يدير الأفاتار الحكومية (مثل، روبوت محادثة مستشار بلدي في الميتافيرس) قابلاً للتحديد بوضوح على أنه غير بشري لتجنب التلاعب أو الخداع.

-

التشغيل البيني للهويات: يجب أن تضمن أنظمة الذكاء الاصطناعي سلامة الهوية الرقمية الفريدة للمواطن (عبر UAE Pass) عند تفاعلها مع الخدمات القائمة على الذكاء الاصطناعي في العالم الحقيقي أو الافتراضي.

الأمن السيبراني المقاوم للكم

بينما تطور دولة الإمارات قدرات الحوسبة الكمومية، يصبح التهديد بفك تشفير البيانات بواسطة أجهزة الكمبيوتر الكمومية أمرًا حقيقيًا.

- دور وكالات الويب في دبي: يجب أن يشمل تطوير المنصات الحكومية وأنظمة الذكاء الاصطناعي المستقبلية اعتماد بروتوكولات التشفير ما بعد الكم (Post-Quantum Cryptography - PQC) لضمان أمن بيانات الصحة والأمن والمواطنين على المدى الطويل.

التدقيق الأخلاقي الآلي

ستتجه دولة الإمارات نحو اشتراط أدوات التدقيق الأخلاقي الآلي.

- المفهوم: بدلاً من عمليات التدقيق اليدوية العرضية، سيتم مراقبة الذكاء الاصطناعي نفسه على مدار الساعة طوال أيام الأسبوع بواسطة نظام ذكاء اصطناعي للمراقبة (Auditing AI)، والذي سيُنبه السلطات في حالة انحراف الأداء، أو اكتشاف تحيزات جديدة، أو انتهاك مبادئ الإنصاف.

الخلاصة والأسئلة الشائعة الاستراتيجية

إن الإدماج الأخلاقي والتنظيمي للذكاء الاصطناعي في الخدمات العامة لدولة الإمارات ليس عقبة، بل هو ميزة تنافسية. فمن خلال وضع نفسها كقائد عالمي للذكاء الاصطناعي المسؤول، تجتذب دبي وأبوظبي المواهب والاستثمارات التي تركز على الثقة.

ملخص المتطلبات الرئيسية

| الجهة الفاعلة |

الأولوية الأخلاقية/التنظيمية |

| الحكومة |

تنفيذ إطار XAI وضمان قابلية تدقيق القرارات والاعتراض عليها. |

| الوكالات التقنية (الويب/المحمول) |

اعتماد مبدأ الثقة بالتصميم، ودمج PDPL في مستوى البنية المعمارية، وإتقان أدوات تخفيف التحيز. |

| المواطنون |

التثقيف حول حقوقهم في الموافقة والاعتراض على القرارات الصادرة عن الأنظمة الآلية. |

الأسئلة الشائعة الاستراتيجية (FAQ) للشركاء التكنولوجيين

س1: كيف يمكن لوكالة ويب في دبي أن تضمن امتثال الذكاء الاصطناعي لقانون حماية البيانات الشخصية؟

ج: يجب على الوكالة أولاً تحديد البيانات الشخصية الحساسة التي يستخدمها النموذج. ثم، يجب عليها التأكد من أن آليات جمع الموافقة صريحة ومفصلة. وأخيرًا، يجب عليها ضمان استضافة البيانات على خوادم موطنة في الإمارات وتصميم واجهات API لوظيفة "الحق في النسيان" (حذف بيانات التدريب) التي يطلبها القانون.

س2: ما هو الإنصاف بالتصميم (Fairness by Design) في السياق الإماراتي؟

ج: إنه نهج يتمثل في دمج الإنصاف منذ بداية عملية التطوير. بالنسبة لوكالة تطوير ويب في دبي، هذا يعني: قبل التدريب، تدقيق مجموعة البيانات بحثًا عن الاختلالات الديموغرافية؛ أثناء التدريب، استخدام خوارزميات تقلل من تباين الأداء بين المجموعات السكانية المختلفة؛ وبعد النشر، مراقبة مقاييس الإنصاف في الوقت الفعلي.

س3: ما هو تأثير الذكاء الاصطناعي الأخلاقي في الإمارات على تكلفة مشروع التطوير؟

ج: إن دمج الأخلاق والامتثال (XAI، تخفيف التحيز، قانون حماية البيانات الشخصية) يزيد من التكلفة الأولية للمشروع. ومع ذلك، فإنه يقلل بشكل كبير من مخاطر التقاضي، والضرر بسمعة الكيان العام، والغرامات التنظيمية. يجب على المستشارين في التسويق في دبي تسويق هذا على أنه استثمار في المرونة التشغيلية وثقة المواطنين.

س4: هل شفافية البلوك تشين إلزامية حقًا لأنظمة الذكاء الاصطناعي في الإمارات؟

ج: ليست إلزامية دائمًا بموجب القانون، ولكن يوصى بها بشدة في حوكمة الذكاء الاصطناعي عالي المخاطر. تعتبر دبي رائدة عالميًا في تبني البلوك تشين. ويُعد استخدام البلوك تشين للتصديق على سلامة مجموعات البيانات وسجلات تدقيق القرار هو الطريقة الأكثر قوة لإثبات الشفافية وعدم التغيير، وهو ما يقدره المدققون الحكوميون للغاية.

س5: كيف يمكن لوكالات الويب في دبي أن تضع نفسها كخبيرة في تنظيم الذكاء الاصطناعي للخدمة العامة؟

ج: يجب أن تحول وكالات الويب مواقعها إلى منصة للقيادة الفكرية. يجب أن تنشر مقالات ودراسات حالة مفصلة حول الامتثال لـ XAI، وأفضل ممارسات قانون حماية البيانات الشخصية، وإدارة المخاطر الخوارزمية. يجب الحصول على شهادات أمنية وامتثال معترف بها. يجب أن تكون الرسالة: "نحن لا نكتفي ببرمجة الذكاء الاصطناعي؛ بل نجعله جديرًا بالثقة."